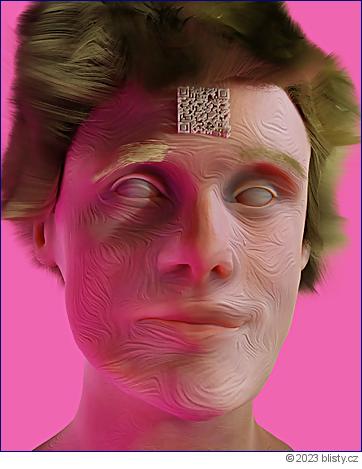

"Objevili jsme tajemství nesmrtelnosti. Špatná zpráva je, že to není pro nás": proč se tvůrce umělé inteligence obává o lidstvo

6. 5. 2023

Geoffrey Hinton nedávno odešel ze společnosti Google. Varuje před nebezpečím umělé inteligence. Opravdu nás umělá inteligence zničí? A jak dlouho máme na to, abychom tomu zabránili?

Hinton, známý jako jeden ze tří "kmotrů umělé inteligence", získal v roce 2018 Turingovu cenu ACM - Nobelovu cenu počítačových vědců za svou práci na "hlubokém učení". Vzděláním kognitivní psycholog a počítačový vědec nebyl motivován touhou radikálně zlepšit technologii: místo toho chtěl více porozumět sám sobě.

"Posledních 50 let jsem se snažil vytvořit počítačové modely, které se dokážou učit věci trochu podobně, jako se je učí mozek, abychom lépe pochopili, jak se mozek učí," říká. Vysvětluje historii svého výzkumu i to, jak ho nevyhnutelně přivedla k závěru, že jsme možná odsouzeni k zániku.

Ve snaze modelovat, jak funguje lidský mozek, se Hinton ocitl mezi vedoucími pracovníky v oblasti "neuronových sítí", což je přístup k budování počítačových systémů, které se mohou učit z dat a zkušeností. Až donedávna byly neuronové sítě kuriozitou, která vyžadovala obrovský počítačový výkon, aby zvládla jednoduché úlohy hůře než jiné přístupy. Ale v posledním desetiletí, kdy se zvýšila dostupnost výpočetního výkonu a rozsáhlých souborů dat, se přístup, jehož průkopníkem byl Hinton, ocitl v centru technologické revoluce.

"Když jsem se snažil přemýšlet o tom, jak by mozek mohl implementovat algoritmus, který stojí za všemi těmi modely, rozhodl jsem se, že to možná nejde - a možná jsou tyto velké modely ve skutečnosti mnohem lepší než mozek," říká.

"Biologická inteligence", jako je ta naše, má podle něj své výhody. Pracuje s nízkou spotřebou, "pouhých 30 wattů, i když přemýšlíte", a "každý mozek je trochu jiný". To znamená, že se učíme napodobováním ostatních. Tento přístup je však z hlediska přenosu informací "velmi neefektivní". Digitální inteligence má naproti tomu obrovskou výhodu: je nesmírně jednoduché sdílet informace mezi více kopiemi. "Platíte obrovské náklady z hlediska energie, ale když se jedna platforma z nich něco naučí, vědí to všechny a vy můžete snadno ukládat více kopií. Takže dobrá zpráva je, že jsme objevili tajemství nesmrtelnosti. Špatná zpráva je, že to není pro nás."

Jakmile se smířil s tím, že vytváříme inteligence s potenciálem překonat lidstvo, následovaly znepokojivější závěry. "Myslel jsem si, že k tomu nakonec dojde, ale měli jsme spoustu času: 30 až 50 let. To už si nemyslím. A neznám žádný příklad toho, že by inteligentnější věci byly ovládány méně inteligentními věcmi - alespoň ne od doby, kdy byl zvolen Biden.

"Musíte si představit něco inteligentnějšího než my, a to stejným rozdílem, jako že jsme inteligentnější než žába. A bude se to učit z webu, bude to mít přečtené všechny knihy, které kdy byly napsány o tom, jak manipulovat s lidmi, a také to uvidí v praxi."

Otřáslo mnou poznání, že digitální inteligence je pravděpodobně mnohem schopnější než biologická inteligence.

Nyní si Hinton myslí, že kritický čas přijde v příštích pěti až dvaceti letech, říká. "Ale nevylučoval bych ani rok nebo dva. A stále bych nevylučoval ani 100 let - jenže moje jistota, že to ještě nějakou dobu nepřijde, byla otřesena uvědoměním, že biologická inteligence a digitální inteligence jsou velmi odlišné a digitální inteligence je pravděpodobně mnohem vyšší kvality."

Stále existuje jakási naděje, že by se potenciál umělé inteligence mohl ukázat jako přehnaný. "V současné době cítím obrovskou nejistotu. Je možné, že velké jazykové modely," technologie, která je základem systémů, jako je ChatGPT, "poté, co spotřebují všechny dokumenty na webu, nebudou schopny jít o moc dál, pokud nezískají přístup i ke všem našim soukromým údajům. Nechci takové věci vylučovat - myslím, že lidé, kteří jsou si v této situaci jistí, jsou blázni." Nicméně říká, že správný způsob, jak uvažovat o pravděpodobnosti katastrofy, je blíže prostému hodu mincí, než bychom si možná přáli.

Tento vývoj je podle něj nevyhnutelným důsledkem technologií v kapitalismu. "Není to tak, že by Google byl špatný. Ve skutečnosti je Google lídrem v tomto výzkumu, základní technické objevy, které jsou základem této vlny, pochází od Googlu a ten se rozhodl je nezpřístupnit přímo veřejnosti. Google se obával všech věcí, kterých se obáváme my, má dobrou pověst a nechce si ji pokazit. A myslím, že to bylo spravedlivé a zodpovědné rozhodnutí. Problém ale je, že v kapitalistickém systému, pokud to pak udělá váš konkurent, nemůžete udělat nic jiného než to samé."

"Jsem jen někdo, kdo si najednou uvědomil, že hrozí nebezpečí, že se stane něco opravdu špatného. Chci, aby se všechny nejlepší mozky, které se vyznají v umělé inteligenci - nejen filozofové, politici a političtí úředníci, ale lidé, kteří skutečně rozumějí detailům toho, co se děje - nad těmito otázkami důkladně zamysleli. A mnozí z nich to dělají, ale myslím, že je to něco, na co se musíme zaměřit," říká Hinton.

Existuje nějaký důvod k naději? "Poměrně často se zdá, že se lidé dostanou ze situací, které se zdály beznadějné, a jsou v pořádku. Třeba jaderné zbraně: studená válka s těmito mocnými zbraněmi vypadala jako velmi špatná situace. Dalším příkladem může být problém 'roku 2000'. Nebylo to nic takového jako existenční riziko, ale to, že to lidé viděli dopředu a udělali kolem toho velký rozruch, znamenalo, že lidé reagovali přehnaně, což bylo mnohem lepší než nereagovat dostatečně.

"Důvod, proč to nikdy nebyl problém, je ten, že to lidé skutečně vyřešili dřív, než k tomu došlo."

Diskuse